إن إنشاء ذكاء اصطناعي يشبه الإنسان هو أكثر من مجرد محاكاة للسلوك البشري ، حيث يجب أن تكون هذه التكنولوجيا قادرة على معالجة المعلومات أيضاً ، أو “التفكير” مثل البشر إذا كان سيتم الاعتماد عليها بشكل كامل.

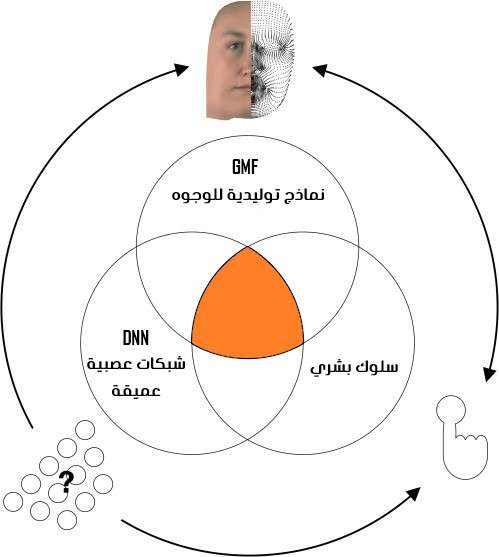

بحث جديد ، نُشر في مجلة Patterns بقيادة معهد علم النفس وعلم الأعصاب بجامعة جلاسكو University of Glasgow’s Institute of Psychology and Neuroscience، يستخدم النمذجة ثلاثية الأبعاد لتحليل الطريقة التي تعالج بها الشبكات العصبية العميقة المعلومات وذلك لتصور الكيفية التي تعالج بها معلوماتها مطابقاً لما يحدث عند البشر.

من المأمول أن يمهد هذا العمل الجديد الطريق لإنشاء تقنية ذكاء اصطناعي يمكن الاعتماد عليها وتعالج المعلومات مثل البشر وترتكب أخطاء يمكننا فهمها والتنبؤ بها.

إحدى التحديات التي لا تزال تواجه تطوير الذكاء الاصطناعي تكمن في كيفية فهم عملية التفكير الآلي بشكل أفضل ، وما إذا كانت تتطابق مع كيفية معالجة البشر للمعلومات ، من أجل ضمان الدقة (الضبط).

غالبًا ما يتم تقديم الشبكات العصبية العميقة على أنها أفضل نموذج حالي لسلوك صنع القرار البشري ، حيث تحقق أو حتى تتجاوز الأداء البشري في بعض المهام. ومع ذلك ، حتى مهام التمييز المرئي البسيطة المخادعة يمكن أن تكشف عن تناقضات وأخطاء واضحة تقوم بها نماذج الذكاء الاصطناعي عند مقارنتها بالبشر.

حاليًا ، تُستخدم تقنية الشبكات العصبية العميقة Deep Neural Networks في تطبيقات مثل التعرف على الوجوه ، وعلى الرغم من أنها ناجحة جدًا في هذه المجالات ، لا يزال العلماء لا يفهمون تمامًا كيفية معالجة هذه الشبكات للمعلومات ، ناهيك عن فهم كيفية وتوقيت حدوث الأخطاء من خلالها.

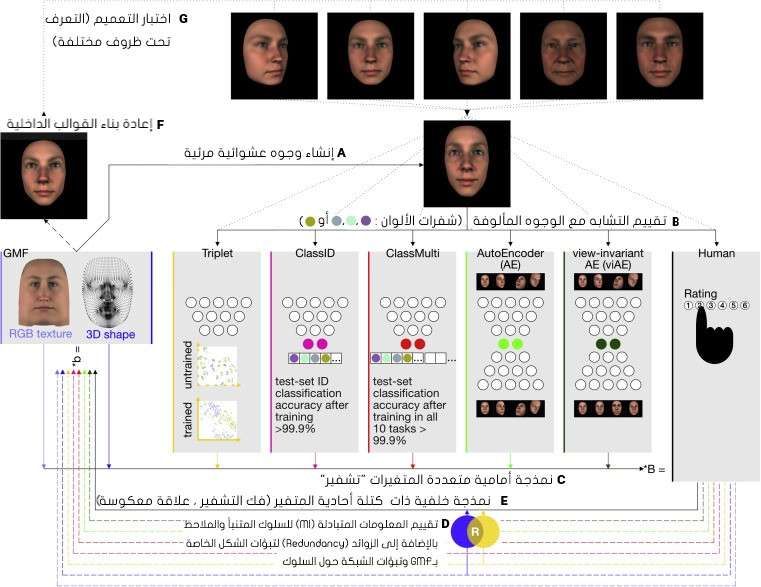

في هذه الدراسة الجديدة ، عالج فريق البحث هذه المشكلة من خلال نمذجة التحفيز البصري الذي أعطته الشبكة العصبية العميقة ، وتحويله بطرق متعددة حتى يتمكنوا من إظهار تشابه في عملية التعرف ، من خلال معالجة المعلومات المتشابهة بين البشر ونموذج الذكاء الاصطناعي.

قال البروفيسور فيليب شينز Prof. Philippe Schyns، كبير مؤلفي الدراسة ورئيس معهد علوم الأعصاب والتكنولوجيا بجامعة جلاسكو: “عند بناء نماذج ذكاء اصطناعي تتصرف مثل البشر”، على سبيل المثال التعرف على وجه شخص ما، بمجرد أن يرى النموذج أنه وجه إنسان سيقوم بالتعرف عليه، ولكن علينا التأكد من أن نموذج الذكاء الاصطناعي يستخدم نفس المعلومات من الوجه التي يستخدمها إنسان آخر للتعرف عليه، فإذا لم يفعل الذكاء الاصطناعي هذا ، فيمكننا أن نتوهم أن النظام يعمل تمامًا مثل البشر ، ولكن بعد ذلك تجد أنه يحدث خطأ في بعض الظروف الجديدة أو غير المختبرة “.

استخدم الباحثون سلسلة من الوجوه ثلاثية الأبعاد القابلة للتعديل ، وطلبوا من مجموعة من البشر تقييم تشابه هذه الوجوه التي تم إنشاؤها عشوائيًا إلى أربع هويات مألوفة. ثم استخدموا هذه المعلومات لاختبار ما إذا كانت الشبكات العصبية العميقة قد صنعت نفس التصنيفات للأسباب نفسها. الاختبار لا يحدد فقط ما إذا كان البشر والذكاء الاصطناعي قد اتخذوا نفس القرارات ، ولكن أيضًا ما إذا كانت هذه القرارات تستند إلى نفس المعلومات.

الأهم من ذلك ، من خلال نهجهم ، سيتمكن الباحثون من تصور هذه النتائج على أنها وجوه ثلاثية الأبعاد تقود سلوك البشر والشبكات معًا. فعلى سبيل المثال الشبكة التي صنفت 2000 هوية بشكل صحيح كانت مدفوعة بشكل كبير بوجه كاريكاتوري مما يدل على أنها حددت الوجوه عن طريق معالجة المعلومات بشكل مختلف تمامًا عن البشر!.

يأمل الباحثون أن يمهد هذا العمل الطريق لتقنية ذكاء اصطناعي أكثر موثوقية تتصرف مثل البشر وتقلل الأخطاء التي لا يمكن التنبؤ بها.

المصادر:

https://techxplore.com/news/2021-10-ai-humans.html [1]

[2] Christoph Daube et al, Grounding deep neural network predictions of human categorization behavior in understandable functional features: The case of face identity, Patterns (2021). DOI: 10.1016/j.patter.2021.100348